在机器学习中,理解和解释模型的预测结果是非常重要的。Shapash是一个强大的Python库,它提供了解析和可视化机器学习模型的工具和功能,帮助开发者更好地理解模型的行为和决策过程。本文将介绍Shapash库的基本概念、主要功能以及如何使用该库来解析和可视化机器学习模型。

Shapash简介

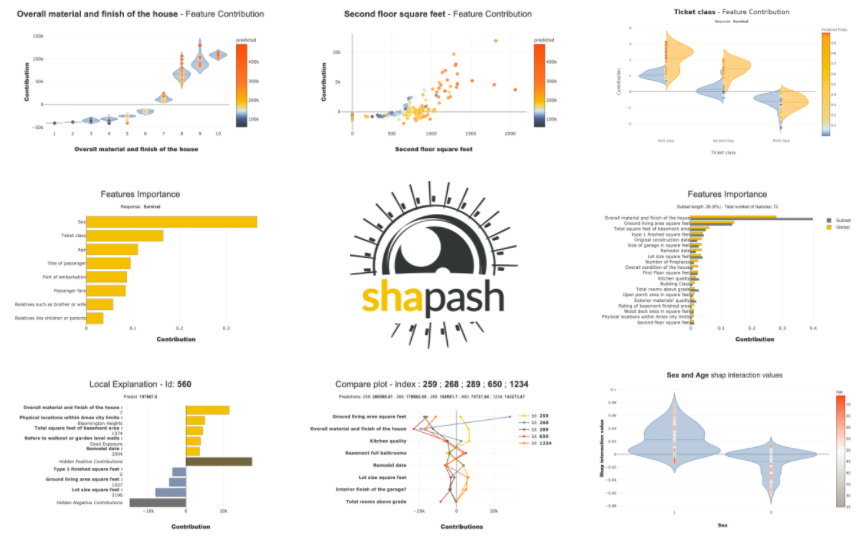

Shapash是一个开源的Python库,其主要目标是解析和可视化机器学习模型。该库基于Shap(SHapley Additive exPlanations)算法,并提供了一套简单易用的接口和工具,使用户能够快速分析和解释模型的预测结果。使用Shapash,开发者可以更好地理解模型的特征重要性、决策过程以及预测结果的可信度。

Shapash的主要功能

- 特征重要性解析:Shapash通过Shap算法计算和解释模型中各个特征对预测结果的贡献度。开发者可以通过Shapash获得每个特征的重要性指标,从而了解模型对输入特征的关注程度和影响力。

- 预测解析和可视化:Shapash可以解析模型的预测结果,并提供可视化工具来展示每个特征对预测结果的影响。通过直观的图表和可视化界面,开发者可以更好地理解模型是如何做出预测决策的,以及不同特征对预测结果的贡献程度。

- 模型信任度评估:Shapash还提供了一些指标和工具来评估模型的信任度和可信度。开发者可以通过这些工具了解模型的稳定性、预测的置信区间以及模型在不同数据子集上的表现。

- 可解释性模型构建:Shapash支持可解释性模型的构建,例如决策树和规则集。这些模型具有更高的可解释性和可理解性,使开发者能够更好地理解模型的决策逻辑和推理过程。

使用Shapash的示例

下面是使用Shapash解析和可视化机器学习模型的简单示例:

import shapash

from sklearn.ensemble import RandomForestClassifier

# 加载数据集

X, y = load_dataset()

# 训练模型

model = RandomForestClassifier()

model.fit(X, y)

# 创建Shapash解析器

explainer = shapash.Explainer(model, X)

# 分析特征重要性

feature_importance = explainer.feature_importance()

# 解析和可视化预测结果

prediction = explainer.predict(X)

explainer.plot_contrib_summary()

# 评估模型的信任度

trust_metrics = explainer.trust()

# 构建可解释性模型

interpretable_model = explainer.interpret()

免费AI编程助手

免费AI编程助手